AIガバナンス手始め

- サイバー・情報セキュリティ

- 経営・マネジメント

2025/7/18

生成AIの利活用については、ハルシネーションや情報漏洩、著作権等の知的財産権侵害等のリスクが存在しています。これらのリスクをコントロールし、AI活用の透明性を確保するためにはAIガバナンスの取組みが重要です。しかし多くの企業にとって、その取組みを一気に充実させることは、コスト面でも、社内手続きの面でも難しいのが実情です。

そこで本稿では、まずは小さく始める「AIガバナンス」体制整備の第一歩である、「AIポリシーの策定」、「AI利用ルールの策定」、「AI管理ルールの策定」の指針についてご紹介します。

AIポリシーの策定

AIの技術進歩や社会実装のスピードの速さ、AIが社会システムに与える影響についての予測困難性に鑑み、AIガバナンスの最適解は常に変化します。そのため「状況に応じて適時適切にルール・仕組みを改修していく」アジャイル・ガバナンスの発想に基づき実践されます。しかし、「ガバナンス=組織統治」である以上、「アジャイル」を免罪符に社内外のステークホルダーの理解や納得を得ることなく、野放図に行うことは許されません。一方、ステークホルダーの理解や納得を得ることに多くの手続きと時間を要するようでは、AI利活用によるイノベーションや業務革新を妨げることとなり本末転倒です。従ってアジャイルなAIガバナンスの実践には、諸施策の改廃の妥当性判断の拠り所(基準)となるAIポリシーを定めることが重要になります。

AIポリシーでは、AIを通じて体現したい価値、AI利用に関して守り通したい倫理観・価値観を定義します。企業の経営理念、フィロソフィーと照らし合わせながら、概ね下表の事項についての自社なりの考え方を盛り込み、策定すると良いでしょう。

| 人間中心の原則 | AIシステム・サービスの開発・提供・利用において、少なくとも憲法が保障する又は国際的に認められた人権を侵すことがないようにする。また、AIが人々の能力を拡張し、多様な人々の多様な幸せの追求が可能となるように行動する。 |

| 安全性 | AIシステム・サービスの開発・提供・利用を通じ、ステークホルダーの生命・身体・財産に危害を及ぼすことがないようにする。加えて、精神及び環境に危害を及ぼすことがないようにする。 |

| 公平性 | AIシステム・サービスの開発・提供・利用において、特定の個人ないし集団への人種、性別、国籍、年齢、政治的信念、宗教等の多様な背景を理由とした不当で有害な偏見及び差別をなくすよう努める。また、それでも回避できないバイアスがあることを認識しつつ、この回避できないバイアスが人権及び多様な文化を尊重する観点から許容可能か評価した上で、AIシステム・サービスの開発・提供・利用を行う。 |

| プライバシー保護 |

AIシステム・サービスの開発・提供・利用において、その重要性に応じ、プライバシーを尊重し、保護する。その際、関連法令を遵守する。 |

| セキュリティ確保 | AIシステム・サービスの開発・提供・利用において、不正操作によってAIの振る舞いに意図せぬ変更又は停止が生じることのないように、セキュリティを確保する。 |

| 透明性 |

AIシステム・サービスの開発・提供・利用において、AIシステム・サービスのユースケースとその外縁の社会的文脈を踏まえ、AIシステム・サービスの検証可能性を確保しながら、必要かつ技術的に可能な範囲で、ステークホルダーに対し合理的な範囲で情報を提供する。 |

| アカウンタビリティ | AIシステム・サービスの開発・提供・利用において、トレーサビリティの確保、ポリシーに記載する各項目の対応状況等について、ステークホルダーに対して、各主体の役割及び開発・提供・利用するAIシステム・サービスのもたらすリスクの程度を踏まえ、合理的な範囲でアカウンタビリティを果たす。 |

| 教育・リテラシー | AIに関わる者が、AIの正しい理解及び社会的に正しい利用ができる知識・リテラシー・倫理観を持つために、必要な教育を行う。また、AIの複雑性、誤情報といった特性及び意図的な悪用の可能性もあることを勘案して、ステークホルダーにも教育を行う。 |

| 公正競争確保 |

AIを活用した新たなビジネス・サービスが創出され、持続的な経済成長の維持及び社会課題の解決策の提示がなされるよう、AIをめぐる公正な競争環境の維持に努める。 |

| イノベーション | 社会全体のイノベーションの促進に貢献するよう努める。 |

出典:総務省・経済産業省「AI事業者ガイドライン」(第1.1版)をもとに東京海上ディーアール作成

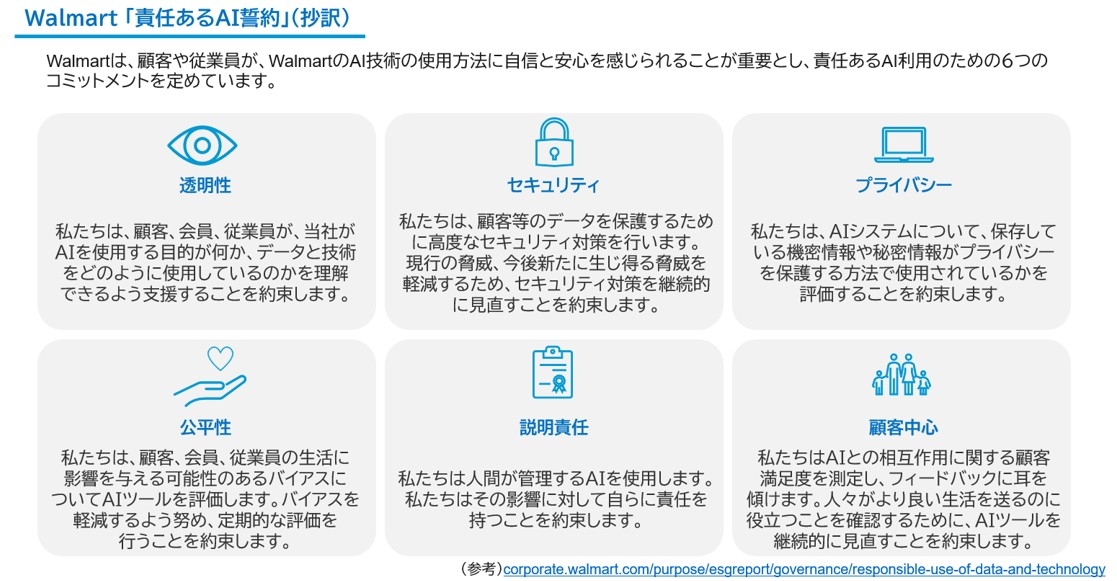

例えば、米国ウォルマートは、「責任あるAI誓約」を策定・公表し、AI利用を促進するにあたって同社が自らに課す責任を示しています。AIポリシーの記載内容やその粒度感についてシンプルでわかりやすい参考事例となっています。

(出典)ウォルマートHP(https://corporate.walmart.com/purpose/esgreport/governance/responsible-use-of-data-and-technology)

をもとに東京海上ディーアール作成

AI利用ルールの策定

自社で活用するAIシステム・サービスについて利用ルールを定めることが、これからAIツールを組織として導入する企業においては最初に取り組むAIガバナンス施策になるでしょう。ユースケースやAIツールの仕様によって細部は異なり得ますが、おおむね下記事項について考慮すると最低限の利用ルールを策定することが可能です。

| Human In the Loopの原則 |

|

| 機密情報・個人情報の取扱制限 |

|

| プライバシー保護 |

|

| 著作権法に準拠したAIの利用 |

|

| 利用可能な端末や環境の制限 |

|

| 使用可能AIと使用禁止AIの区別 |

|

出典:東京海上ディーアール作成

AI管理ルールの策定

AI管理ルールにおいては、AIシステム・サービスの開発・調達・提供の各場面で、品質・倫理・セキュリティを確保するために取り組むべき事項や、AIの利用許可やリスク管理を行う役員・部署の特定、それら部署のAIマネジメントに係る事務分掌等を定義します。可能であれば組織におけるAIリスクのモニタリング・軽減活動の具体的な手順・仕組みまで踏み込んで規定するとよいでしょう。具体的には以下の事項を盛り込みます。

| AIの管理レベルの定義 |

EU AI Actや韓国のAI基本法等を参考に、リスクレベルに応じてAIを分類し、分類ごとの利用承認権限と利用条件について定める。 |

| 責任者・担当部署の明確化 |

AI管理を所掌する担当役員・担当部署・担当部署の活動を補佐する部署と、各々の事務分掌について定める。 AI管理についての全社的な意思決定を行う組織の設置や、第三者による関与の仕組みの構築も検討する。 |

| AIシステム・サービスの管理プロセス(管理実施手順)の明示 | AIの管理レベルごとに、企画・開発・提供・利用時のリスク評価・セキュリティ評価・プライバシー影響評価の実施方法について規定する。また、AI管理担当部署によるAIシステム・サービスの利用承認までのプロセス(実施手順)について定義する。 |

| AIリテラシー向上のための取組み | AIポリシー、AI利用ルール、AI管理ルール定着のための研修等の実施について規定する。 |

出典:東京海上ディーアール作成

なお、AI管理ルールについては、アジャイル・ガバナンスの実践及びイノベーション阻害防止の観点から、その改廃をAIガバナンス担当部署の専決とすることが推奨されます。但し、AIガバナンス担当部署による改廃権限は、別途定めるAIポリシーの範囲内とするべきです。

まとめ

AIガバナンス手始めとしての「AIポリシーの策定」「AI利用ルールの策定」「AI管理ルールの策定」に際して検討の指針となる事項について紹介しました。繰り返しになりますが、AIの技術進歩や社会実装のスピードの速さ、AIが社会システムに与える影響についての予測困難性に鑑み、AIガバナンスの最適解は常に変化します。そのため、初めから完璧なAIガバナンス施策を実施することは困難です。従って、まずはできるところから、少しずつアジャイルに始めていくことが肝要です。

弊社ではAIガバナンス・AIマネジメント体制の構築支援等サービスの提供を行っております。以下のリンクから詳細をご確認ください。

※このコラムは誤字脱字のチェックや文章の推敲に一部生成AIを用いています。

執筆コンサルタントプロフィール

- 牛島 康晴

- CDOユニット 主任研究員