AIガバナンスとは?

- 経営・マネジメント

- サイバー・情報セキュリティ

2025/6/19

2025年5月28日、参議院本会議で可決・成立した「人工知能関連技術の研究開発及び活用の推進に関する法律」(いわゆるAI推進法)では、AIの開発・提供・利用をする事業者の責務として、AIの透明性の確保に努めることとされました(ご参考:「AI推進法」に見るAIリスクマネジメントに関する事業者の責務 | コラム | 東京海上ディーアール株式会社)。この責務を充足するために、AIガバナンスの取組みがいよいよ重要となってきています。

本稿では、AI推進法の成立を受け、ますます注目を集める「AIガバナンス」について改めてご紹介します。

AIガバナンスの定義と重要性

AIガバナンスとは、「AIの利活用によって生じるリスクをステークホルダーにとって受容可能な水準で管理しつつ、そこからもたらされる正のインパクト(便益)を最大化することを目的とする、ステークホルダーによる技術的、組織的、及び社会的システムの設計並びに運用」(総務省 経済産業省「AI事業者ガイドライン」(第1.1版))のことを言います。もう少し平易に言い換えるなら、「AIシステム・サービスの開発・提供・利用に関して、社会規範、法令を遵守し、お客様をはじめとした様々なステークホルダーから受容いただくことをもって当該システム・サービスの利用を活性化し、多くの人が便益を享受できるようにするための管理・統制体制の設計・運用」となるでしょう。

AIを安心・安全に活用し、なおかつAI推進法で明示された透明性確保の責務を充足するため、企業はAIガバナンスに取り組むことが重要になります。例えば以下のような事柄をAI開発・提供・利用におけるルール・業務フローとして定型化し、運用していくことがAIガバナンスの取組みに該当します。

- 企業の経営理念、フィロソフィー、大切にしたい倫理観に照らして、AI活用が適切かを判断すること。

- AIの開発・提供・利用が既存の規則や法律にのっとったものであるか精査すること。

- AIが活用するデータが適切に取得されたものであるか、バイアス等を含んだものではないか評価すること。

- AIが個人や社会全体の日常生活にどのような影響を与えうるかを評価すること。

しかし、AIの技術進歩や社会実装のスピードは極めて速く、将来の企業・法規制・市場・社会規範といった社会システムに与える影響を事前に予測することは困難であるため、そうした社会の変化・流れに応じてAIガバナンスの最適解は常に変化していきます。したがって、AIガバナンスの実践に当たっては、「一度決めたルール・仕組みを守り抜く」という従来発想ではなく、「状況に応じて適時適切にルール・仕組みを改修していく」というアジャイル・ガバナンスの発想を取り入れていくことが重要です。

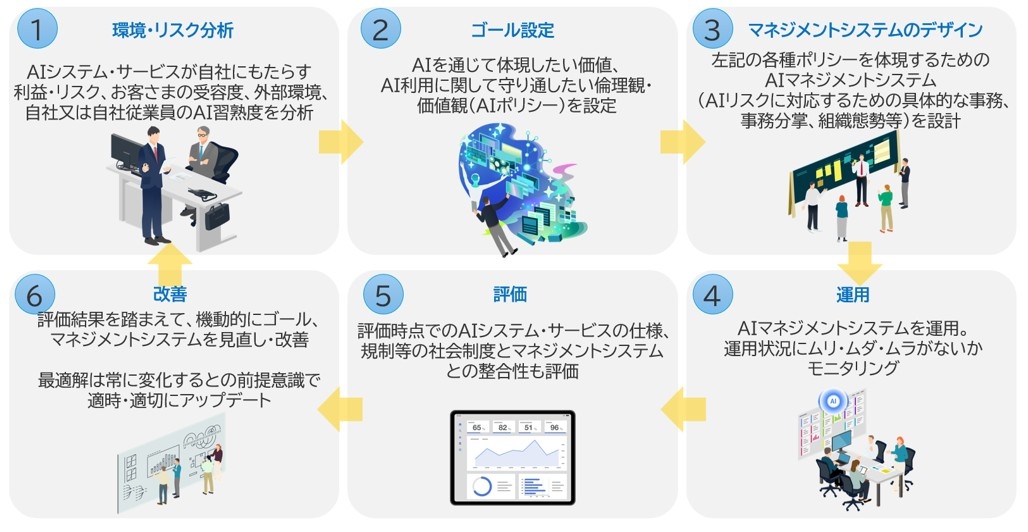

アジャイルなAIガバナンスの実施方法

アジャイルなAIガバナンスの実施サイクルは次のとおりです。

出典:筆者作成

このサイクルを、AI技術の進展や社会システムの変化に合わせて円滑に回していくことが求められます。しかし、AIガバナンスは全社的な取組みとなるため、その実施には経営層がリーダーシップを発揮することが必要不可欠です。また、AIガバナンスは、技術的知見とその技術の利用形態について倫理的・法的・社会的文脈から評価するための知見とが必要な複合的取組みです。そのため社内の様々な部署を巻き込んだ、それ相応の体制を構築して取り組むことが必要となります。

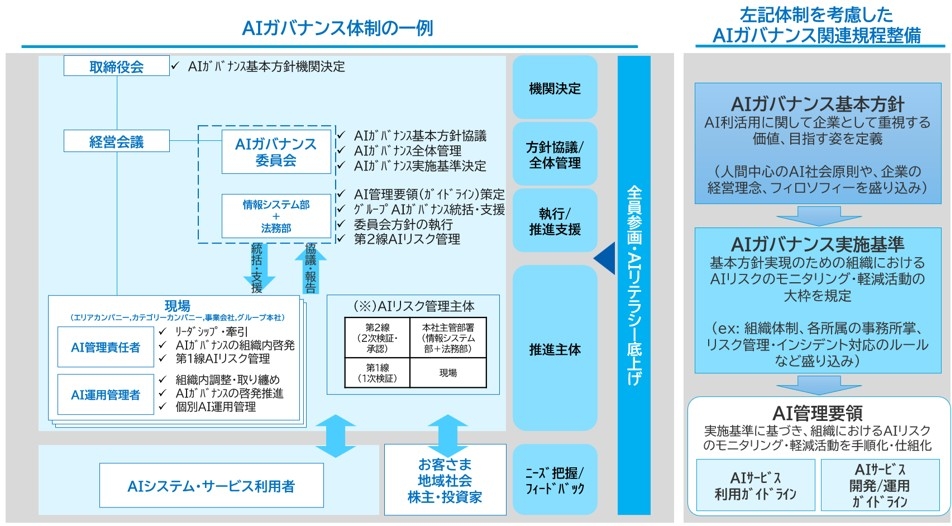

AIガバナンスの実践に向けた体制構築

先にも述べたとおり、AIガバナンスの実践には、経営層と様々な部署のコミットメントが重要ですので、全社でAIガバナンスの取組みを統括する組織とAIガバナンスの実務を担う部署を設置し、当該組織を中心にAIガバナンス体制を構築します。例えば次のような体制と、その体制を動かすための規程を整備することが考えられます。

出典:筆者作成

可能であれば、AIガバナンスの実務を担う部署以外の各部門にも、既存の事務分掌・権限の延長線上でAIガバナンスに主体的に関わってもらえるような役割分担を検討するのも一考です。例えば人事部門はダイバーシティや人権、雇用、働き方への影響の観点からAIのリスク評価を、法務部門は著作権等関連法令との関係性の観点からのAIリスク評価を、営業部門等顧客と相対する部門においてはそれぞれの所掌事務の範囲で顧客に与えうる影響に関するリスク評価を行ってもらうことで、徐々に全社参加の安全文化としてAIガバナンスを根付かせます。

一方で、AIリスクへの対応に偏重し、以上の体制をあまりに厳重に運営してしまうと現場の負担が重くなり、AI利活用によるイノベーションや業務革新を妨げる原因ともなり得ます。そのため、AIガバナンスにおける実務部分に係る段取りの改廃については、組織で定めたAIガバナンスのゴールと不整合が発生しない限りは、AIガバナンスの実務を担う部署の専決で行えるようにするといったルールを定めることが重要です。ここでいう実務部分における段取りとは、例えばAIリスクチェックリストの整備・改定、AIシステム・サービスの管理台帳の整備、監査実施方法・監査頻度、個別のAIシステム・サービスに関するリスク対応方策の規格導入等が該当します。

まとめ

AI推進法の施行により、事業でのAI研究開発・活用における透明性の確保が企業の責務となりました。企業はAIガバナンスの構築を通じ、透明性確保のための取組みを明確に業務フローに落とし込み、責任あるAIの利活用を実現することが重要です。

弊社ではAIの透明性確保に関するAIガバナンス・AIマネジメント体制の構築支援等サービスの提供を行っております。以下のリンクから詳細をご確認ください。

執筆コンサルタントプロフィール

- 牛島 康晴

- CDOユニット 主任研究員